O conceito do evento: The M.E.T. Effect

por Emerson Weirich

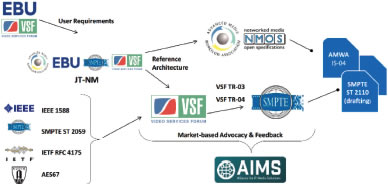

A NAB Show de 2017 em Las Vegas, Estados Unidos, teve como marca o “M.E.T Effect” (um acrônimo para Media, Entertainment and Tech-nology). É uma referência ao efeito dos dois distintos campos de Mídia, Entretenimento e Tecnologia que estão se somando de uma forma diferenciada e que agora de fato convergem em um novo ecossistema digital. Este “efeito” é impulsionado pela conectividade à Internet e pelos sistemas integrados, abrindo novas oportunidades de negócios, novos fluxos de trabalho e possibilidades de receita. Já percebemos isso há um certo tempo, mas essa edição da NAB Show foi marca-da pela movimentação do mercado formando alianças corporativas buscando o desenvolvimento de padroni-zação nos produtos e serviços que os consumidores de conteúdo digital estão demandando. Os fabricantes, associações, alianças e grupos de padronização forma-ram diferentes times que estão trabalhando nas novas tecnologias de tráfego de vídeo em redes IP de alta capacidade para substituição de tráfego SDI, OTT e no-vos modelos de compressão mais eficientes nos novos cenários de entrega de conteúdo. Os principais grupos de trabalho atualmente são:

1. AIMS – Alliance for IP Media Solutions

2. AMWA – Advanced Media Workflow Association

3. EBU – European Broadcasting Union

4. JT-NM – Joint Task Force on Networked Media

5. MPEG – Moving Picture Experts Group

6. SMPTE – Society of Motion Picture and Television Engineers

7. VSF – Video Services Forum

8. WAVE – Web Application Video Ecosystem

Este artigo vai apresentar em parte os trabalhos des-tes grupos e suas perspectivas tecnológicas a curto prazo, quais são as especificações e quais os padrões técnicos que estão sendo trabalhados. Cinema, pro-paganda, jogos eletrônicos, tecnologias imersivas, eventos ao vivo, televisão, vídeo, som, tecnologias móveis, mídias sociais e rádio estão envolvidos neste “efeito” onde produzir conteúdo em alguns casos se torna mais fácil e mais eficiente em termos de custos, e onde o comportamento da audiência é novo. Enfim o mercado audiovisual está se adaptando, se ajustando e se reinventando para os próximos anos.

A estratégia apresentada pela FOX Networks

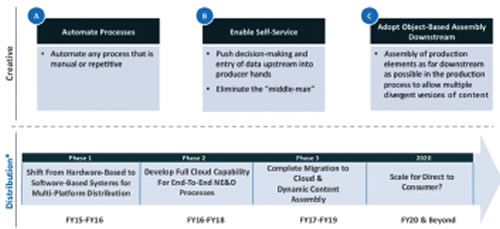

O VP de Engenharia e Desenvolvimento da FOX Networks, Thomas Edwards, apresentou no congresso a visão da empresa e os desafios colocados pela sua estratégia tecnológica para o ano 2020. A FOX está implementando uma cadeia de suprimento de mídia baseada em nuvem pública e nuvem privada. Isso in-clui transcodificação, encapsulamento, controle de qualidade, legendas, closed caption e gerenciamento de metadados de arquivos de vídeo, preparando-os para distribuição. Os objetivos do projeto incluem a redução dos custos de mão-de-obra, o aumento da resiliência, flexibilidade e agilidade.

Estratégia de engenharia da FOX Networks para 2020 apresentada no congresso da NAB

Dentro do fluxo de trabalho de criação a tendência é de automação dos processos manuais, habilitando o auto-serviço dos produtores, ou seja, os processos estarão na mão dos produtores sem intermediários.

A ideia da FOX Networks é que em 2020 não sejam mais utilizados equipamentos exclusivos de Broadcast e sim um Broadcast Data Center específico que aten-derá aos pré-requisitos de flexibilidade, multi-formato HD-4K-8K, utilização de equipamentos de TI de prate-leira, escalável, processamento de mídia por software, virtualização e de cloud híbrida.

Diversos dispositivos de captação de imagem em Realidade Virtual apresentados na NAB

Tecnologias imersivas de áudio e vídeo

O mercado de Realidade Virtual e de Realidade Au-mentada tem crescido no último ano e estima-se que a receita pode alcançar mais de sete bilhões de dólares neste ano. No início imaginava-se que a tecnologia faria muito sucesso nos Games, o que de certa for-ma foi frustrado pelo mercado. Mas segundo alguns especialistas as tecnologias de Realidade Virtual são a nova plataforma para divulgar marcas e produtos. E também é possível ver iniciativas de produção em vídeos de esportes e aventura. Os publicitários e pro-dutores entendem que as tecnologias imersivas são mais cativantes e emocionantes. São tecnologias na-tivamente móveis, em função dos dispositivos móveis já possuírem os sensores de movimento necessários para estas aplicações.

São equipamentos que estão sendo desenvolvidos com diversas câmeras acopladas para captar imagens mono ou imagens estereoscópicas em três dimensões e para todos os lados. Também possuem microfones para captar áudio em diferentes direções e assim dar a sensa-ção mais realista possível da cena. As imagens e os áu-dios das várias câmeras e microfones são sincronizadas e processadas para formarem a sensação de 360 graus.

Ainda não existem formatos padronizados para as tecnologias imersivas.

Dispositivos de visualização de imagens e sons imersivos

Isto causa muita dificuldade técnica para a calibração geométrica e sincronismo dos vários vídeos captados simultaneamente, um com-plexo ajuste de colorimetria e multi-processamento de imagem. Por isso as ferramentas de edição ainda estão sendo desenvolvidas nos padrões da indústria audio-visual. É necessário desenvolver os padrões para se ter um ecossistema adequado de produção nestas tec-nologias e atingir a qualidade de experiencia do usuá-rio (QoE – Quality of Experience) que se almeja. A ideia é dar a sensação realística de copresença, ou seja, é um conceito de criação de ambiente onde as pessoas têm a sensação de estar virtualmente no local, via uma conexão de rede.

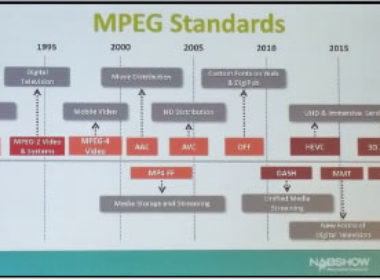

O futuro das tecnologias de compressão

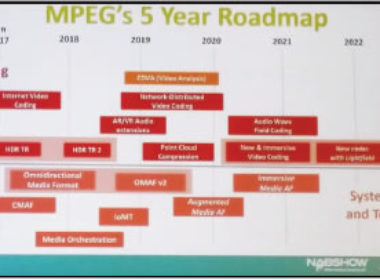

Historicamente o MPEG (Moving Picture Experts Group) formado pela ISO (International Organization for Standardization) para definir padrões para a com-pressão e transmissão de áudio e vídeo, acompanha o mundo audiovisual já por algumas décadas. São vários os padrões que foram desenvolvidos para atender as necessidades da indústria em cada momento.

Pelas transformações que o mercado audiovisual está passando, os novos alvos do MPEG para os próximos anos são:

— O crescimento das plataformas de distribuição

em IP e da mídia Mobile.

— Maior qualidade de imagem, UHD

(Ultra High Definition) em 4K e 8K.

— Mais mídia imersiva em Realidade Virtual (VR – Virtual Reality) e Realidade Aumentada (AR – Augmented Reality).

— As mídias presentes na Internet das Coisas (IoT – Internet of Things).

— Processamento, armazenamento e distribuição baseados em nuvem.

A ideia é que em 2020 já se tenha um codec especí-fico MPEG para vídeos imersivos.

Com a migração da distribuição de conteúdo para am-bientes com taxas de transmissão variáveis e estatís-ticas, novas pesquisas estão sendo realizadas para o desenvolvimento de novos CODECs eficientes. Em stre-amings ABR (Adaptative BitRate) o vídeo é codificado usando simultaneamente várias taxas fixas de transmis-são, o receptor escolhe a melhor taxa em função da banda disponível na recepção. Existem várias críticas para o ABR pois a técnica se adapta às condições de rede e não ao conteúdo em si, ou seja, em alguns mo-mentos de rede lenta o conteúdo vai ser prejudicado e em alguns momentos a taxa alta transmitida é desne-cessária, consumindo escassos recursos de rede. Várias pesquisas mostradas durante a NAB estão baseadas no conceito de Content Adaptative Encoding, ou seja, são CODECs que conseguem verificar o melhor custo/bene-fício em relação à taxa de compressão conforme o tipo de conteúdo, desta forma a qualidade é mantida sem desperdiçar banda e sem consumir exagerados tempos de processamento para codificar os vídeos (ou seja, métodos escaláveis). Algumas pesquisas de novos CO-DECs já demonstraram eficiência de mais de 60% na taxa de transmissão para vídeos em 1080p.

“Roadmap” para um OTT padronizado

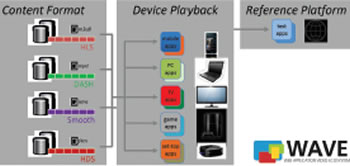

A distribuição de áudio e vídeo tornou-se generali-zada na Internet pelos serviços comerciais e são ofe-recidos por vários provedores de serviços através de várias plataformas de entrega. Mas nem todos os dis-positivos de reprodução suportam os mesmos forma-tos de áudio e vídeo. O acordo sobre formatos comuns e padrões comuns de aplicativos ajudaria produtores de conteúdo, provedores de serviços, fabricantes de dispositivos e desenvolvedores de aplicativos. Reco-nhecendo esses desafios, a CTA (Consumer Technology Association) estabeleceu um esforço de engenharia para identificar uma solução baseada em padrões para interoperabilidade de aplicativos de áudio e vídeo em OTT (Over The Top). Ele é formado por um grupo de empresas que estão trabalhando no projeto WAVE (Web Application Video Ecosystem).

O projeto WAVE está estreitamente focado em permitir a interoperabilidade entre aplicativos comerciais de áudio e vídeo, serviços e dispositivos conectados. Os serviços OTT atualmente utilizam vários formatos e dispositivos específicos, ou seja, quando um vídeo é reproduzido em dispositivos diferentes, são inúmeros os problemas téc-nicos que podem acontecer como: falhas na comutação de bitrates, CODECs incompatíveis, dimensionamento da imagem em displays diferentes, instabilidade na re-produção de longa duração, descontinuidades de áudio, deficiências de protocolo, insuficiência de memória e de CPU, problemas com imagens HDR, entre outros. É alvo do projeto criar uma plataforma de referência em HTML5 para testes de playback para que assim os desenvolve-dores de produtos possam descobrir previamente pro-blemas de incompatibilidade e encontrar soluções.

O objetivo do projeto WAVE é criar padrões mundiais de interoperabilidade em OTT entre conteúdos e dispositivos, proporcionando uma plataforma de referência © Fotos: WAVE

Pelo cronograma do projeto, ainda em 2017 devem ser entregues as especificações de conteúdo, especifi-cações de aplicativos e as especificações de compati-bilidade dos dispositivos.

Perspectivas de equipamentos nos novos padrões IP/Ethernet sem compressão

Já são aproximadamente 10 anos de trabalho para tornar possível o tráfego de vídeo profissio-nal ao vivo de estúdio sem compressão em IP. Durante anos, o padrão SDI tem sido o padrão co-mum para o transporte de vídeo sem compressão dentro das instalações das emissoras de televisão, e permitiu que as emissoras conectassem equipa-mentos, sabendo que funcionariam em conjunto.

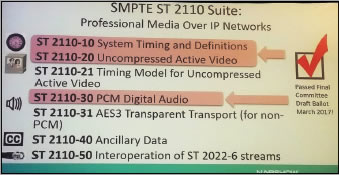

Esquema das principais partes do suíte da norma SMPTE ST 2110 apresentado por Thomas Edwards,

VP de Engenharia e Desenvolvimento da FOX Networks, sendo que algumas partes já estão com o texto aprovado em março deste ano © Foto: FOX Networks

O primeiro padrão que transporta SDI em IP é o SMPTE ST 2022-6 onde os 1376 octetos de da-

dos SDI são colocados em um pacote RTP (Real-time Transport Protocol) e é adicionado outro layer de pro-tocolo para ter alta precisão de clock e metadados, o HBRMT (High-Bitrate Media Transport Protocol). A ado-ção do padrão 2022-6 significa que podemos recriar tudo o que fazemos em SDI com o 2022-6, ou seja, vídeo, áudio e dados são a mesma estrutura do SDI só que agora encapsulados em IP. É um padrão relati-vamente simples de implantação e que cria uma base de interoperabilidade com infraestruturas já existentes em SDI. Este padrão já foi bem implementado e a maioria dos fabricantes já mostraram produtos na feira NAB Show 2017 e que oferecem conexão em 2022-6.

Contudo o padrão SMPTE ST 2022-6 não tem toda a flexibilidade que uma rede Ethernet pode propiciar. O novo padrão SMPTE ST 2110 para transporte de mí-dia sem compressão nas infraestruturas de televisão foi muito discutido no congresso da NAB Show 2017.

Visão geral do envolvimento dos vários grupos e alianças de empresas responsáveis pela norma SMPTE ST 2110 Fonte: http://aimsalliance.org

Com este novo padrão, o áudio, o vídeo e os dados são divididos e carregados separadamente e são re-combinados utilizando padrão SMPTE 2059 de sincro-nização, resolvendo dificuldades técnicas não-triviais associadas com a mudança de sistemas tradicionais baseados em SDI para sistemas baseados em IP. O pa-drão SMPTE ST 2110 também utiliza a recomendação RFC 4175 que especifica um esquema de pacote RTP para encapsular vídeo sem compressão em um formato de payload que carrega apenas pixel de vídeo ativo, ou seja, economiza banda de rede. O áudio utiliza o padrão existente AES67.

Quanto à aplicação da norma SMPTE ST 2110, segundo pesquisa feita com os membros da aliança AIMS, cerca de 72% dos fabricantes vai lançar equipamentos com-patíveis com o padrão 2110 ainda em 2017. São equipa-mentos que incluem câmeras, routers, vídeo-servidores, sistemas de playout, switchers de aúdio e vídeo, enco-ders, processadores de áudio e vídeo e multiviewers.

Para mostrar que o SMPTE ST 2110 é a realidade de um padrão unificado de áudio e vídeo sem compres-são sobre rede em IP/Ethernet, algumas empresas de radiodifusão e de tecnologia se juntaram na feira NAB Show 2017 em um estande de demonstração chamado de IP Showcase. Neste estande vários equipamentos de várias marcas foram interligados em SMPTE ST 2110 para comprovar a interoperabilidade e demostrar o compromisso conjunto do mercado em tornar a indús-tria de televisão melhor, mais flexível e mais eficiente.

A NAB deste ano foi muito promissora em mostrar o progresso de engenharia com exemplos do mundo real de aplicações em equipamentos em IP/Ethernet. O questionamento que fica é quando cada empresa deverá migrar sua estrutura para um fluxo de IP no estúdio e quando será seguro migrar para um fluxo de IP sem compressão no estúdio. É hora de se preparar para esta transição muito importante da interface dos equipamentos de estúdio e para as várias possibilida-des técnicas futuras que isso nos trará.

Emerson Weirich, Diretor Regional da SET no Centro-Oeste e Gerente Executivo de Engenharia da EBC. Contato:

[email protected]