|

Inseridos sob todos os aspectos, os conteúdos das palestras do Congresso SET 2011 foram apresentados a partir dos diversos pontos de vista que envolvem os temas eleitos. À frente da elaboração da programação do congresso, o vice-presidente da SET, Olimpio Franco, juntamente com o grupo de tecnologia, procurou abordar nos painéis todas as etapas da cadeia de oferta eletrônica de conteúdo audiovisual, captação, processamento, armazenagem, exibição e distribuição, chegando também às telas grandes e pequenas. Por sua vez, os moderadores buscaram palestrantes representantes da indústria, do governo, da radiodifusão, das teles e de entidades ligadas ao setor, tanto em âmbito nacional como internacional.

E isso pôde ser notado na cerimônia de abertura. Os congressistas lotaram o auditório para ouvir o que os representantes de entidades e governo tinham para falar. Após, uma semana da aprovação do Projeto de Lei da Câmara (PLC 116), a presidente da SET, Liliana Nakonechnyj começou seu discurso falando sobre impacto que ele dará ao mercado brasileiro e, consequentemente, trará à engenharia de televisão no setor de radiodifusão. “A entrada das Teles na distribuição de TV paga, certamente, aumentará as ofertas ao consumidor e a demanda por mão de obra especializada na tecnologia de distribuição. A determinação de cotas de conteúdo nacional, tanto por canal como por serviço, e a preservação das etapas de produção e programação para empresas brasileiras, seguramente, fortalecerão os mercados de trabalho de serviços e de equipamentos. Tudo isso só aumenta a responsabilidade da SET e seu objetivo principal em difundir as tecnologias mais avançadas de forma a apoiar as melhoras ofertas à população brasileira. No entanto, nosso congresso traz o que há de mais avançado em termos de tecnologia de TV”.

O Brasil está tão à frente com suas tecnologias que este ano, a União Internacional de Telecomunicações (UIT) enviou um representante para falar, exclusivamente, na abertura do Congresso da SET e participar de algumas palestras. O coordenador de serviço de radiodifusão do Bureau de radiocomunicação, Pham Nhu Hai, falou em nome do Secretário Geral da UIT Hamadoun Toum Tourré. Em seu discurso reforçou a visão mundial sobre o caminho das comunicações, salientou o progresso do Brasil no desenvolvimento do setor e enfatizou o papel crítico e importante que terá no século 21.

De acordo Alexandre Annenberg, superintendente da Associação Brasileira de TV por Assinatura (ABTA), a cerimônia de abertura foi muito interessante porque ela levantou a maioria dos problemas que todos deverão enfrentar juntos. “A digitalização e a banda larga modificaram radicalmente o cenário da radiodifusão e da telecomunicação. E nós temos que trabalhar juntos para tirar desse instante uma plataforma de inclusões social e digital brasileiras”.

Segundo Paulo Machado de Carvalho Neto da Associação Brasileira de Emissoras de Rádio e Televisão (Abert), o Congresso da SET é importante, primeiro pela reciclagem das pessoas, depois pela oportunidade que se tem de discutir assuntos e trocar conhecimento de novas tecnologias e equipamentos”.

Participaram também da mesa, na cerimônia de abertura: André Barbosa, assessor especial do Ministério da Casa Civil, representando a Ministra Chefe da Casa Civil Gleisi Hoffmann, Genildo Lins de Albuquerque Neto, secretário de serviços de comunicação eletrônica representando o Ministro das Comunicações Paulo Bernardo, Emilia Ribeiro, conselheira da Agência Nacional de Telecomunicações (Anatel), Ara Apkar Minassian, superintendente de Comunicação de Massa da Anatel representando o embaixador Ronaldo Mota Sardenberg presidente da Anatel, Olimpio José Franco, vice-presidente da SET, Roberto Franco, presidente do conselho deliberativo do Fórum SBTVD e ISDB-T Internacional, Frederico Nogueira, representando João Carlos Saad, presidente da Associação Brasileira de Radiodifusores (Abra), e Rodrigo Neves, presidente da Associação das Emissoras de São Paulo (AESP).

Painéis em destaque

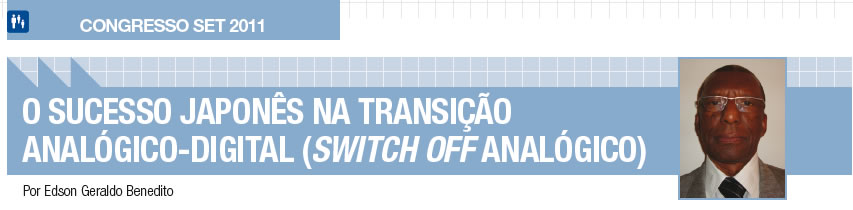

Espectro e switch off foram os temas que se destacaram no Congresso SET 2011. Nas salas, durante as palestras, era possível ouvir algo associado, direto ou indiretamente, aos dois assuntos. O espectro é um tema de interesse total dos radiodifusores e que passou a ser vislumbrado pela área de telecomunicação. O switch off foi recentemente concluído no Japão, definindo assim seu processo de transição para o digital. Uma equipe de brasileiros esteve no Japão e acompanhou o processo. E o fator mais impressionante foi o cumprimento do cronograma do switch off japonês no tempo determinado.

Logo no primeiro dia da programação do Congresso, o tema foi debatido na sessão Planejamento de Canalização Digital no Brasil, sob o título “Switch off analógico no Japão”. A consultora da SET e moderadora, Tereza Mondino, elogiou as apresentações dos palestrantes. “O painel foi muito interessante. Nós tivemos a representante do Ministério das Comunicações Patricia Ávila, que nos contou como foi o switch off analógico no Japão, incluindo os trabalhos de planejamento, preparação e efetivação, pois eles cumpriram todos os prazos que eles planejaram. Tivemos, também, um balanço sobre o planejamento da TV digital. O trabalho dos estudos dos canais foi encerrado em maio e agora a Anatel está processando as consultas públicas e efetivação da inclusão desses canais. A publicação está prevista para setembro ou outubro e em dezembro haverá uma revisão final para contemplar as últimas autorizações”.

Ainda neste painel o consultor da SET, André Cintra, disse que o Congresso da SET serve como uma prestação de contas dos trabalhos realizados com a TV digital, ressaltou a importância de fazer um plano de ajuste após o switch off analógico e enfatizou a importância da flexibilização das normas para acelerar a implantação da TV digital.

Segundo o advogado Édio Azevedo, consultor jurídico do Ministério das Comunicações em 2010, “a questão é que a legislação da radiodifusão é de 1962. E de lá pra cá a tecnologia mudou completamente. Apesar de existir tentativas de inclusão da reforma das leis da radiodifusão, a discussão não segue em frente porque não há interesse de todos os grupos que a legislação seja revisada. Enquanto que a leis da Telecomunicação estão sempre avançando as de radiodifusão estão estagnadas em 1962. O PLC116, por exemplo, tem um grande mérito que unifica todos os serviços de TV por assinatura – via cabo, satélite e ar – em um serviço só. Possibilita também a entrada dos players de telecomunicação do mercado das grandes Teles que poderão fazer TV por assinatura. A expectativa deste projeto é que facilite primeiro o trâmite dos processos de TV por assinatura, diminua os custos vinculados às licenças e possibilite a oferta de serviços à maior parte da população, que não é contemplada com TV por assinatura. Hoje apenas doze por cento da população tem esse tipo de serviço”.

O superintendente da Anatel, Ara Apkar Minassian em sua consideração final deixou duas perguntas aos congressistas: Será que para as emissoras, que estão entrando no ar agora, compensa ter um sinal analógico? Não seria interessante começar a operar já no sistema digital?

No painel “TVD Automação” moderado pelo diretor da regional norte da SET, Nivelle Daou Jr., a palestra apresentada foi o “Programa na TVD: O papel da Automação ISDB-T: Como comandar o Mux? Dificuldades? Soluções?”, cada palestrante falou de uma parte da automação e dentro das suas experiências as informações se complementaram. Segundo Nivelle, o objetivo foi mostrar a importância da automação uma vez que estão ficando cada vez mais difíceis os controles manuais. O painel mostrou uma visão bastante geral de todas as fases e o desenvolvimento que existe na área de automação.

Nos painéis dos acadêmicos científicos, o balanço foi positivo. De acordo com o diretor de ensino da SET, Carlos Nazareth, foram apresentados 12 trabalhos, em dois dias de congresso. “As apresentações foram muito interessantes, principalmente, ao percebermos em várias delas a necessidade de verificar alguns aspectos que estão sendo discutidos na consolidação da TV digital. Todos os trabalhos tiveram uma nuance bem interessante, mostrando aquilo que realmente existe de importante nas pesquisas atuais e que podem impactar numa tecnologia de médio/curto prazos e que vai virar usual do telespectador, que por sua vez, é a fonte de todo trabalho”.

Liliana alertou que o espectro seria novamente um dos assuntos mais polêmicos. E foi! Para o diretor da regional Sul da SET, Fernando Ferreira, moderador do painel “Espectro – Escasso e Disputado”, este assunto foi bem abordado e com isso foi dado o início a tentativa de buscar um acordo no uso desta canalização de 700 MHZ. Nós envolvemos todos os lados da questão. Nós tivemos Leila Loria da Telefônica, Patrícia Ávila do Minicom, Marcos de Souza Oliveira, gerente geral de certificação e engenharia de espectro, Paulo Ricardo Balduíno da Abert, e Marcos de Oliveira da Anatel. Nós sabemos que o espectro é um bem finito e todo mundo quer os mesmos canais porque é onde há melhor propagação. Esse é um assunto que será muito debatido ainda.

Como não poderia deixar de ser, o Rádio digital também foi pauta do congresso. Duas sessões mostraram a importância desse meio de comunicação. A palestra “Rádio Digital: Melhorias/DRM: Resultados dos testes/RD: Perspectivas no Brasil”, moderado por Marco Tulio da TV Globo, serviu para discutir a situação do Rádio brasileiro e contou com a presença do representante do Ministério das Comunicações Almir Pollig que falou sobre os trabalhos que o Governo está realizando em prol do Rádio. “Já estão sendo feitos testes com o sistema DRM e Rádio HD nas cidades do Rio de Janeiro, São Paulo, Belo Horizonte e Belém pela equipe de engenharia do Ministério das Comunicações e a previsão é que estes testes sejam concluídos até dezembro, apesar de estar no cronograma a finalização em fevereiro de 2012”.

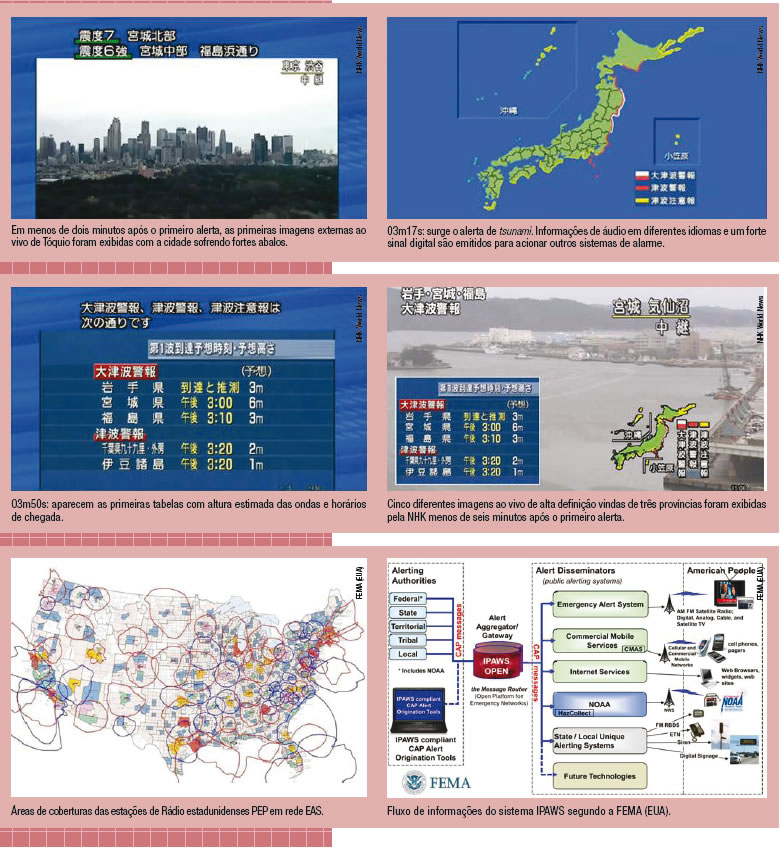

O moderador Marco Tulio ao final de seu painel enalteceu o valor do Rádio, principalmente no tocante à transmissão de alertas de emergência e pediu para que o diretor de Rádio da SET, Ronald Barbosa, moderador da sessão seguinte, contasse aos congressistas como o Rádio foi importante quando teve, em agosto, o terremoto nos Estados Unidos. “Durante o terremoto, o único meio de comunicação que continuou funcionando, e por meio dele as pessoas puderam obter informações, foi o Rádio”, relatou Ronald, que acredita que o painel “Sistema de Alerta de Emergência”

“O painel serviu para abrir um debate sobre um tema que tem muito assunto a ser debatido, pois os envolvidos na questão do sistema de alerta querem sedimentar um caminho para que a população tenha acesso à situação de emergência. A intenção é descobrir que tipo de protocolo é necessário para fazer a comunicação não só na radiodifusão, porque o Brasil já tem condições de fazer isso”, afirma.

Nova campanha

Além das novas tecnologias de interatividades apresentadas no estande do Fórum SBTVD, este ano também foi lançada durante o congresso, a campanha publicitária 2011 sobre a TV digital. Segundo Liliana, coordenadora do módulo de promoção do Fórum, os indicativos para esta campanha saíram do Fale Conosco do site do DTV. Por isso, a nova campanha tem o objetivo de esclarecer a facilidade de captação do sinal digital para TV aberta, que sua disponibilidade é livre, gratuita e basta ter um televisor com o selo DTV ligado à antena UHF.

Criada pela agência Light Comunicação e produzida pela SPTelefim Produções, a campanha é apresentada em três filmes e já começou a veiculada nas emissoras de TV aberta associadas ao Fórum. Você também pode conhecer a nova campanha publicitária no site: www.forumsbtvd.org.br.

O Fórum Internacional ISDB-T também aproveitou a oportunidade e realizou o segundo encontro presencial dos representantes dos países que adotaram o ISDB-T. De acordo com o presidente do Fórum, Roberto Franco, “neste encontro foi possível perceber que aqueles que adotaram o sistema têm tido o comportamento de auto disposição na implantação do sistema, reforçando o que nós prevíamos, que se o sistema brasileiro fosse adotado em outros países haveria uma implantação mais rápida, visto a facilidade de implantação, estabilidade das normas, confiabilidade da plataforma, além é claro, de a transferência e geração de conhecimento entre os países”. Dos doze países que formam o grupo, apenas três não estavam presentes.

Feira tecnológica Feira tecnológica

Mais uma vez o Sindicato das Indústrias de Aparelhos Elétricos, Eletrônicos e Similares do Vale da Eletrônica (Sindvel), levou para a feira o seu Projeto Comprador e criou um ambiente para seus participantes na feira Broadcast & Cable. Entre as empresas voltadas para a radiodifusão estavam: Ativa, AGTechnologies, Biquad, JWSAT, Ideal Antenas, Teclar e o Instituto Nacional de Telecomunicações (Centro de Competência do Inatel).

O crescimento de 40 por cento de estandes resultou um aumento de 20 por cento no número de visitantes na comparação à edição anterior. E o último dia de feira, foi o mais concorrido. Nos dois primeiros dias, a Certame, empresa organizadora da feira, contabilizou cerca de 5,9 mil visitantes, número que praticamente dobrou na soma final, totalizando quase 12 mil pessoas. De acordo com Janaina Fardim, coordenadora geral do evento, o movimento de visitantes foi bastante positivo e muitos negócios foram fechados durante a Broadcast & Cable.

Foi no espaço da feira que a Linear aproveitou para anunciar a fusão entre ela e a japonesa Hitachi. De acordo com o diretor da Linear, Robinson Gaudino Caputo, “a princípio a fusão é de 50 por cento, mas há perspectiva de que chegue a 70 por cento Hitachi e 30 por cento Linear”. Apesar de a negociação ter sido anunciada agora, segundo o diretor geral da Hitachi, Shinji Nakamura, “as negociações ainda estão em andamento, mas podemos entender que a empresa já vai começar a comercializar os produtos da Linear”. “A fusão internacional tem como objetivo cobrir o mercado e tornar a iniciativa a maior empresa de radiodifusão do mundo”, anunciaram.

Prêmio SET 2011

Não faltaram sorrisos, comemorações, aplausos e agradecimentos à entidade pela realização do Prêmio SET. A noite foi de muita alegria. Os premiados estavam realizados com suas criações e felizes pelo reconhecimento do esforço empregado na geração de um produto, um texto, uma filosofia e pela contribuição que deram ao setor. Ao total foram oito premiados numa noite de festa para todos.

|

|

|

O diretor Danti Conti, da Transtel, recebeu o troféu de Melhor Lançamento de Transmissão e/ou Recepção pela Antena Slot Elíptica que aumenta a densidade de energia e oportunidade de recepção para uma mesma área de cobertura da emissora. Isto agrega margem no sistema, robustez de recepção e uma maior imunidade espacial experimentada pelos receptores fixos em ambientes internos e receptores móveis em ambientes externos

|

A Sony faturou dois prêmios este ano. O diretor de marketing da Sony, Izumi Nakajima, recebeu o prêmio de Melhor Lançamento de Produção e Pós Produção com a câmera PMWF3L que oferece uma grande variedade de opções de criação de imagem e, além de outros atributos, integra a tecnologia S-35mm a um preço acessível de forma portátil. O segundo prêmio foi recebido pelo presidente Shige Morikawa pelo Melhor Lançamento em Inovação Tecnológica com a linha de Monitores OLED Trimaster que redefine a tecnologia de monitoração de referência com o uso de processamento de imagem inovador desenvolvido para substituir o CRT em aplicações de monitoração e avaliação críticas de imagens. |

|

|

O engenheiro Cleveland Albuquerque (segundo da direita para esquerda) da TV Globo recebeu o prêmio de Melhor Projeto em Novas Mídias pelo Aplicativo para smartphone e tablets, IOS e Android desenvolvido para acompanhar o Campeonato Brasileiro de futebol 2011. Com esse aplicativo, o usuário pode ler as notícias de todos os times e durante cada jogo pode obter estatísticas da partida.

|

|

|

| Os engenheiros Salustiano Fagundes e Paulo Feres receberam o prêmio de Melhor Projeto Interatividade pelo aplicativo HXD de interatividade desenvolvido para a MG TV DTVi. Trata-se de uma iniciativa pioneira, por ser o primeiro telejornal na TV aberta do país a ter um aplicativo DTVi compatível com as normas do ISDB-T. |

A Melhor Apresentação do Ciclo Acadêmico Científico foi dos alunos da Universidade Mackenzie pelo trabalho: “Análise objetiva HDTV do H.264 x MPEG-2 com e sem perda de pacotes”. Os engenheiros Eduardo Santos Bueno, Cristiano Akamine, Renato de Mendonça Maroja e Gustavo de Melo Valeira são os responsáveis pela tese.

|

|

|

| O engenheiro Nelson Faria levou o prêmio de Melhor Apresentação do Congresso em 2010 pelo painel “Novos Equipamentos de Captação de 35 mm para Produção de Televisão”. |

Pela segunda vez, Alberto Paduan foi o vencedor de Melhor Artigo Publicado na Revista da SET nas edições 2010 e 2011 até junho, com o artigo Produção e Pós Produção de Vídeo – partes 1 e 2.

|

|

|

|

Uma das palestras do dia 23 de agosto foi sobre o tema “Esportes”, moderada pelo diretor de cinema da SET Alex Pimentel e proferida por Sven Schaeffner, da Fédération Internationale de Football Association – Federação Internacional de Futebol (Fifa), Bart Utterbeeck, da Newtec e Rubens Ortiz, da Rede Bandeirantes.

Alex abriu os trabalhos apresentando os participantes e os respectivos temas a serem abordados.

Bart abriu o ciclo apresentando o case “Tour de France – Cobertura de um evento itinerante”, uma famosa prova de ciclismo que acontece, anualmente, no mês de julho, na França, coberta pela TV francesa VTM através de contribuições ao vivo e off-line num programa diário, transmitido no horário nobre da emissora chamado “In het wiel van de tour” (Na roda do tour), poucos minutos após o final de cada etapa.

Trata-se de um dos mais prestigiados tours ciclísticos da Europa que acontece desde 1903. É um longo evento esportivo com duração de três semanas, contendo dois dias de descanso, disputado por etapas percorrendo 3.600 Km em vias públicas e estradas ao redor da França e atingindo alguns países vizinhos como Espanha, Bélgica, Suíça, Alemanha e Itália. A irregularidade do circuito dificulta de forma absurda o trabalho das equipes da emissora.

Há alguns anos, a Irlanda, Inglaterra e países baixos são incluídos no percurso. Por isso, os dois dias de descanso durante a prova são aproveitados para o transporte dos ciclistas devido às grandes distâncias e dificuldades de acesso entre o local de uma etapa e a seguinte. O palestrante, de início, contou algumas curiosidades sobre o evento. Uma delas é com relação às cores das camisas que identificam os líderes, entregues aos competidores ao final de cada etapa, numa cerimonia especial. A camisa amarela, por exemplo, é entregue ao primeiro corredor em tempo individual na classificação geral, portanto a mais importante; a camisa verde é a do melhor colocado na classificação individual por pontos de cada etapa; a camisa branca com bolas vermelhas é dada ao primeiro competidor a chegar ao topo de cada montanha. Existem outras cores de camisetas atribuídas às classes individuais da competição, tendo cada uma delas suas histórias e motivos de adoção.

Outra curiosidade é com relação aos torcedores que acompanham todo o trajeto, muitos deles com roupas e bicicletas malucas, tal e qual acontece na nossa famosa São Silvestre.

Acompanham também a prova muitos carros e motos de serviço, fornecendo alimento, água, assistência médica e mecânica aos participantes, sendo que alguns deles atendem a todos os corredores e outros, somente, às próprias equipes.

O que sobra nessa prova são os acidentes. Só para ter uma idéia, na sua primeira edição, em 1903, 60 participantes iniciaram a prova e apenas 21 a terminaram. Tanto que dizem que o Tour de France é sangue, suor e lágrimas para os atletas.

Cada final etapa é transmitida ao vivo pela televisão e exibida através de um telão. Nesse momento, são também transmitidas ao vivo as entrevistas oficiais com os corredores a partir de um estúdio de TV. Com tudo isso, dá para se imaginar as dificuldades e desafios encontrados pelas emissoras de TV nessa cobertura.

Bart também falou sobre a tecnologia empregada. É um evento itinerante, sem infraestrutura fixa, ou seja, tudo tem que ser montado e improvisado a todo o momento, na maioria das vezes na base de improvisação, com um mínimo de planejamento, com pouco tempo para efetuar uma coordenação com a matriz, dispondo de pouco espaço e em lugares remotos.

As transmissões realizadas pela Vlaamse Televisie Maatschappij (VTM) – principal estação de televisão comercial do norte da Bélgica de língua alemã – são feitas ao vivo do campo, num trabalho que envolve muita eficiência, pois emprega uma equipe pequena, trabalhando através de acessos à internet e e-mails, com contribuições de arquivos via Fast News Gathering (FNG), com soluções compactas, de fácil instalação e bastante confiáveis.

No campo não é possível a utilização de banda larga, embora na França já esteja disponível o 3G, pois o sistema fica completamente congestionado devido ao enorme uso feito pelos torcedores e componentes das equipes. As comunicações e contribuições são feitas via ASI nas transmissões ao vivo e IP para a internet e FNG, envolvendo equipamentos e técnicas de transporte DualFlow.

A utilização do FNG possibilita um aumento substancial da eficiência e na velocidade de produção de conteúdo, reduzindo o “time to air” num trabalho realizado por um número menor de pessoas, onde os próprios jornalistas gravam e arquivam o conteúdo, fazendo o voice-over, a edição não-linear, etc. Trabalhando num ambiente totalmente informatizado. O objetivo é “ser novidade”, sendo o primeiro a chegar com contribuições curtas e soluções compactas. A utilização do FNG possibilita um aumento substancial da eficiência e na velocidade de produção de conteúdo, reduzindo o “time to air” num trabalho realizado por um número menor de pessoas, onde os próprios jornalistas gravam e arquivam o conteúdo, fazendo o voice-over, a edição não-linear, etc. Trabalhando num ambiente totalmente informatizado. O objetivo é “ser novidade”, sendo o primeiro a chegar com contribuições curtas e soluções compactas.

O transporte via DualFlow envolve conexão, transporte e interatividade entre o ASI e o IP da seguinte forma:

• Conexão: suporta ambas as interfaces (IP e ASI), permitindo às emissoras a realização da transição entre elas, no momento mais conveniente;

• Transporte: possibilita às emissoras o transporte dos sinais ao vivo a transferência de arquivos de maneira eficiente via satélite;

• Interatividade: o DualFlow viabiliza a conexão em duas vias através do satélite, introduzindo novos serviços interativos nos processos de broadcast melhorando a produtividade.

Essa comunicação pode ser realizada através de três configurações selecionáveis do sistema. A primeira, para transmissão de TV ao vivo, pelos métodos tradicionais de transmissão MPEG. A segunda para envio de arquivos pela transmissão de dados IP. A terceira pela transmissão simultânea de Transport Stream (TS) e serviços IP.

Esses equipamentos DualFlow estão instalados nas Digital Satellite News Gathering (DSNG) que são operadas pelo departamento de Tecnologia da Informação (TI) e possuem capacidade satelital através da European News EXchange (ENEX) – organização sem fins lucrativos para a troca de noticiários e serviços de transmissão entre emissoras de televisão). A VTM possui 800 kHz always-on (24 horas/7 dias por semana) e n x 3.8 MHz slots para uso ocasional.

A VTM utiliza duas configurações para o evento. Uma delas, para transmissão de conteúdos off-line e log-in iNews, enviar traduções, ler e enviar e-mails, fazer coordenação, pesquisar e enviar dados. A outra configuração é para a transmissão de vídeo em multistream e para priorizar o conteúdo ASI sobre o conteúdo IP.

Os benefícios alcançados com essa tecnologia são a redução do Capital Expenditures (CAPEX) – total dos investimentos realizados na aquisição e instalações de equipamentos para manter um serviço ou para manter em funcionamento um negócio ou um determinado sistema -, uma vez que o transporte de vídeo e IP é realizado pelo mesmo equipamento e, ainda, com a possibilidade de enviar vários canais de vídeo e dados pelo mesmo equipamento; o aumento da produtividade fazendo da DSNG um escritório remoto com acesso à internet, serviço de e-mail, navegador e transferência de arquivos; implementação de novos fluxos de trabalho com possibilidade de operação multi-câmeras com transmissão das imagens em paralelo, envio de metadados e download de arquivos e edição local.

Em seguida, o palestrante, Rubens Ortiz, contou sobre a experiência da Band na cobertura do evento INDY-SP300 em São Paulo em 2010 e 2011. A TV Bandeirantes foi a Host Broadcast da corrida, distribuindo o sinal para mais de 200 países do mundo.

Rubens explicou que tiveram que trabalhar com quatro situações: um sinal de áudio e vídeo internacional (para todos os países), um sinal de áudio e vídeo especial para os Estados Unidos (Sinal Versus) e um sinal especial para o Brasil (Sinal Brasil).

Para o vídeo internacional foram utilizadas 32 câmeras de circuito, oito câmeras on-board, uma BeautyCam, um Ultra Slow-Motion trabalhando com mil frames por segundo para a reta final, um helicóptero com câmera HD, três câmeras especiais no chão da pista, três câmeras remotadas sob a passarela, uma câmera instalada no topo do hotel com lente 100X e oito EVS de quatro canais. Tudo isso alimentando um routing switcher em cuja saída havia um switcher para os cortes de câmeras do vídeo internacional, outro switcher para o corte dos replays internacionais e mais oito EVS de quatro canais.

O sinal especial dos EEUU, Sinal Versus, foi formado pelo Sinal Internacional mais duas câmeras wireless para repórteres e PIT e oito câmeras on-board para destaques, alimentando o Switcher Versus que tinha nas suas saídas um SNG-USA com redundância.

O Sinal Brasil, teve o Sinal Internacional alimentando o Switcher Band mais seis câmeras para reportagem, PIT e camarotes e duas câmeras para cabine e camarote. A saída do switcher alimentava um SNG com redundância. O grafismo americano foi inserido nos Estados Unidos e o grafismo brasileiro foi feito durante a transmissão através de dois geradores de caracteres.

Para o áudio internacional foram utilizados 32 microfones de câmeras de circuito, oito áudios de câmeras on-board, três microfones de câmeras de pista, três microfones de câmeras de passarela, áudio do helicóptero e áudio de comunicação pilotos-boxes. Esses sinais alimentavam o routing switcher que enviava para a saída o áudio internacional 5.1 canais. O áudio Versus tinha, além do áudio internacional, oito áudios de câmeras on-board e dois microfones de repórter – PIT. O áudio Brasil foi composto pelo áudio internacional mais oito áudios de câmeras on-board, seis microfones de repórter PIT mais dois microfones de camarote, além do áudio de cabine. A equipe técnico-operacional foi composta por 400 profissionais.

Além da transmissão da corrida, a Band foi a responsável pela contratação de serviços de monitoração (painéis de LED e televisores dos camarotes), montagem de circuito fechado de TV com imagens da transmissão, chamadas e comerciais, alimentando os painéis de LED e os televisores e pela viabilização de streaming para alimentação da internet.

Segundo Rubens, em 2010, o circuito era para eles muito complicado e quase que indefinido, provocando um grande trabalho de engenharia, planejamento e estratégia para a cobertura. No ano seguinte, já com certo know-how os trabalhos transcorreram com mais tranquilidade.

Encerrando o ciclo de palestras, foi a vez de Sven Schaeffner, gerente geral da Fifa TV – escritório Brasil -, falar sobre as atividades operacionais da Fifa na Copa de 2010. Iniciou exibindo um vídeo sobre a transmissão da Copa Fifa 2010.

Disse que para cada um torcedor assistindo o jogo no estádio existiam 10 mil vendo pela TV, e que mais de 95 por cento do que é visto na TV é produzido pelo Host Broadcaster, a produtora anfitriã ou produtora oficial do sinal internacional.

O papel do Host Broadcaster é bastante complexo. Sua tarefa é organizar as operações de TV e Rádio da Copa do Mundo; produzir o sinal internacional dos 64 jogos do evento; oferecer todos os serviços e facilidades de produção para os licenciados dos direitos conformes suas necessidades individuais; desenvolver, construir e gerenciar o International Broadcast Centre – Centro Internacional de Transmissão (IBC) e se responsabilizar pelas operações relacionadas à imprensa.

Falou que o processo de escolha e gerenciamento do IBC 2010 teve muitos desafios, porém o resultado foi compensador, tendo sido um dos melhores IBCs de todos os tempos. Na área das telecomunicações desse IBC, a missão do Comitê Organizador e do HBS era assegurar uma infraestrutura suficiente para atender os requerimentos da Fifa. As preparações começaram em 2007 e foram entregues sem absolutamente nenhuma falha. No quesito Plataforma Móvel, os principais obstáculos foram o processo de venda e a estrutura joint venture com alguns licenciados de direitos. Também foi um absoluto sucesso resultando na entrega de 64 jogos ao vivo. Com relação ao 3D, foi lançado seis meses antes da abertura da Copa, mas apresentou um resultado de 25 jogos produzidos e distribuídos mundialmente.

O IBC é o cérebro das operações globais. Opera 24/7, ou seja, 24 horas por dia durante os sete dias da semana. Atua com cerca de 3 mil profissionais, 106 emissoras numa área de 30 mil m² e é o centro de produções da HBS para programas multi-feed SD e HD, produção 3D, equipes de reportagem (ENG) da Fifa TV, produção para plataforma móvel e servidor Fifa Max (centro de dados com alto conteúdo de informações para utilização aberta).

A distribuição do World Feed envolve, em cada sede dos jogos, uma unidade móvel de produção, um sistema de comunicação e um sistema backup de up-link para um satélite doméstico, visando prever falhas provenientes do IBC como uma que ocorreu há cerca de três anos. No IBC, esse sinal é recebido, produzido e novamente enviado para outro satélite para contribuição World Feed.

O Comitê Organizador previu também feed para plataformas móveis, incluindo gráficos adaptados para telas pequenas, uso de uma câmera dedicada na plataforma principal misturada com outros ângulos utilizados pelo diretor de TV, disponibilização de comentários guia em inglês e disponibilização no IBC com gráficos SD e HD.

Em 2010, a Fifa executou cobertura ostensiva com 40 equipes de reportagens da Fifa TV fornecendo conteúdo diversificado dos times nos centros de treinamentos, forneceu conteúdo adicional no dia anterior ao jogo (treino oficial, entrevista à imprensa, etc) e enviou aproximadamente 18 horas de material ao IBC todos os dias. Em 2010, a Fifa executou cobertura ostensiva com 40 equipes de reportagens da Fifa TV fornecendo conteúdo diversificado dos times nos centros de treinamentos, forneceu conteúdo adicional no dia anterior ao jogo (treino oficial, entrevista à imprensa, etc) e enviou aproximadamente 18 horas de material ao IBC todos os dias.

Para o 3D, a decisão foi tomada em 2009 e foi anunciada durante o sorteio final, em dezembro de 2009, que, em parceria com a Sony, seriam transmitidos 25 jogos da Copa de 2010 em 3D. A partir daí, foram feitos nove testes, utilizando oito câmeras e feito um filme oficial divulgando o evento.

Acrescento que, para isso, a Sony desenvolveu um projeto combinando processadores, switcher, lentes e plataformas de câmeras. Tudo foi montado numa carreta da T16 HD da produtora Telegenic, do Reino Unido e também numa outra carreta da Car8 HD da produtora AMP, da França. As duas carretas foram embarcadas para a África em aviões Antonov (foto). A unidade da AMP produziu os eventos em Johanesburgo, nos estádios Ellis Park e Soccer City. A unidade móvel da Telegenic fez os jogos em Durban, Cape Town e Port Elizabeth. ]

A Fifa, em conjunto com a Africa Union of Broadcasting (AUB), desenvolveu um programa de ensino para a comunidade de emissoras africanas que foi lançado em abril de 2009 com o objetivo de formar, de uma maneira sustentável, jornalistas esportivos de nível internacional como um instrumento profissional para obter uma cobertura de futebol mais rica e ensinando técnicas para produzir novas e mais interessantes imagens e reportagens sobre a Copa Fifa de futebol na África. Como resultado, a final da Copa Fifa da África alcançou uma audiência de mais de 900 milhões de telespectadores em casa e mais de um bilhão incluindo a audiência externa. Tendo exibido um vídeo institucional da FIFA com cenas belíssimas (Media Circus Promo), Sven disse que aquelas imagens justificam os investimentos tão altos numa copa do mundo de futebol. Revelou que o IBC do Brasil será no Rio Centro, no Rio de Janeiro, e também que não pode assegurar que a nossa Copa Fifa seja realizada em 3D, encerrando assim sua apresentação.

Alex Pimentel abriu a sessão de perguntas e respostas, questionando o que mais estaria por vir nas três modalidades esportivas apresentadas durante as palestras (ciclismo, corrida automobilística e futebol). Sven Schaeffner foi o primeiro a emitir sua opinião e disse que no futebol a única coisa onde ele acha possível haver um incremento é no vídeo, principalmente com relação ao 3D. Rubens Ortiz concordou com Sven, mas falou que, tecnicamente, as coberturas estão no auge. Para Bart Utterbeeck, em termos de transmissão, a tecnologia tem como mudar sim, principalmente, no campo das fibras ópticas.

Os apresentadores foram bastante aplaudidos, revelando assim o grau de satisfação da plateia com a qualidade dos painéis apresentados.

Alberto é Supervisor de Projetos da TV Cultura de São Paulo, diretor da Adeseda – Consultoria e Projetos e Coordenador e Revisor Técnico da Revista da SET. E-mail: [email protected]

|

|

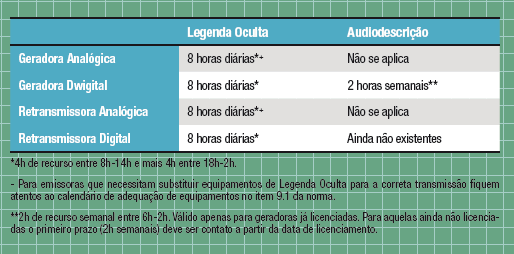

A diretriz dos palestrantes foi a Legislação da Acessibilidade, composta pela lei número 10.098 de 19/12/200 que “estabelece normas e critérios básicos para a promoção da acessibilidade das pessoas portadoras de deficiência ou com mobilidade reduzida”, que produziu a Norma N° 001/2006 de 27/06/2006 sobre os “recursos de acessibilidade, para pessoas com deficiência, na programação veiculada nos serviços de radiodifusão de sons e imagens e de retransmissão de televisão”, e também das portarias n° 310, de 27/06/2006; n° 466, de 30/07/2008; n° 661, de 14/08/2008; n°188, de 24/03/2010, que alteram as disposições da Norma 001.

A palestra foi iniciada com o painel apresentado por Ricardo Fontenelle que dissertou sobre a adoção do padrão EIA 608, estabelecendo que o Closed Caption deve ser inserido para transmissão na linha 21 do Intervalo de Apagamento Vertical dos sistemas de televisão. Listou em seguida alguns problemas típicos do CC relacionados à compressão da imagem, à configuração de encoders, IRDs e processadores de sinal e sobre os monitores com sub-set de recursos.

Ricardo falou sobre os modos de inserção do CC, tais como a transcrição em tempo real, o mais complicado deles, e também à transcrição com o texto pronto inserido em tempo real e pré inserido. Mostrou o diagrama de um sistema de inserção em tempo real.

Segundo o palestrante, existem alguns bugs de codificação de Closed Caption em receptores analógicos que tendem a aumentar com o incremento da complexidade do DTV. Com relação às normas de CC relativas aos sistemas de DTV, as principais são:

ABNT NBR 15606-1

Arib B24 (codificação)

Arib B37 (transporte)

O segundo painel foi conduzido por Monique Cruvinel que dissertou sobre a Acessibilidade na TV aberta de uma maneira geral, contemplando os recursos de acessibilidade como a “legenda oculta”, que é uma forma de transcrição, a “audiodescrição”, uma forma de tradução, a dublagem, outra forma de tradução e a LIBRAS, também uma forma de tradução.

Falou sobre o trabalho de legislação da acessibilidade e seu andamento, dando um destaque especial à legislação da audiodescrição (AD), mencionado no início dessa matéria, cujo conteúdo pode ser acessado integralmente no endereço www.mc.gov.br. Explicou a dificuldade dos deficientes visuais para acessar conteúdos através da tela da TV, facilitado atualmente pelos controles remotos dedicados a essas pessoas, com teclas específicas para esse tipo de acesso.

Algumas reclamações que ocorrem com frequência são com relação aos equipamentos de recepção que não permitem a execução do Closed Caption, com relação à capacitação de profissionais para esse tipo de produção e também que, embora seja possível, não é obrigatória a inserção da legenda oculta (Closed Caption) em one-seg.

Monique frisou que a obrigatoriedade de transmissão da audiodescrição existe, atualmente, apenas para as geradoras digitais. Disse ainda que, sendo a audiodescrição um tipo de tradução, transmitindo num canal de áudio (SAP) os aspectos do vídeo relacionado, não pode de forma alguma imprimir um senso crítico da imagem transmitida.  Atualmente, a legislação exige das geradoras duas horas semanais de audiodescrição. Atualmente, a legislação exige das geradoras duas horas semanais de audiodescrição.

Falou sobre as quatro fases abrangidas pela produção, que são:

• o roteiro, ou seja, a tradução do vídeo para o áudio;

• a inserção da AD, por locutores, atores ou dubladores;

• a mixagem feita pelos operadores de som;

• os consultores, que levantam a importância do público alvo.

Alguns problemas que mais afetam a utilização da AD são a falta de certificação de profissionais para a sua execução; a existência de cursos com duração de cerca de 40 a 50 horas, porém muito caros; e que nem todos os programas conseguem ter uma boa AD.

Sobre a LIBRAS (Linguagem Brasileira de Sinais), Monique disse que a inserção já está em vigor e é obrigatória para todos os partidos políticos e campanhas de instituições políticas. Ressaltou que todos esses recursos precisam ser simultâneos e que também devem ser disponibilizados em one-seg.

O terceiro palestrante, Raphael Barbieri, abordou o Closed Caption numa visão mais operacional para as emissoras. Explicou o que vem a ser o CC, suas formas de geração e as diferenças com relação à legendagem. Falou ainda sobre os equipamentos necessários para a sua geração. No sinal analógico o CC é definido pelo protocolo CEA 608, e no digital pelo Arib STDB24 Part 3.

Foram mostrados dois cenários de equipamentos utilizados com o sinal digital ISDB-TB. Disse que até 2016 o CC deverá ser transmitido tanto no sinal analógico como no digital. Como último palestrante do painel, Augusto Magalhães dissertou sobre as formas de produção do Closed Caption baseados em voz e os outros tipos de CC que são o Off-line e o On-Line. Destacou os tempos de preparação e a quantidade de informação que cada um desses tipos exige.

Mostrou um breve histórico sobre o Closed Caption dizendo que o projeto foi iniciado em 1960 pela IBM/CIA como um sistema de tradução automática de outro idioma qualquer para o inglês.

Descreveu o equipamento utilizado na estenotipia mostrando suas qualidades e modo de trabalho com digitação de códigos ao invés de caracteres, como forma de agilizar a digitação. Mostrou também a dificuldade do trabalho e a consequente extensão dos cursos de preparação dos estenotipistas.

Augusto abordou ainda as características necessárias para o locutor de CC, como a fala contínua versus fala discreta e o uso dos vocabulários (vocabulário curto-central telefônica e vocabulário extenso). Explicou o funcionamento de um sistema de reconhecimento de voz, detalhando sua conversão analógico-digital, a quebra de palavras em fonemas e a comparação dos fonemas com as palavras do dicionário.

Segundo Augusto, a precisão inicial do sistema é de cerca de 70 a 75 por cento de tudo o que é dito pelo usuário, índice esse que é aumentado através do treinamento e uso contínuo do sistema, fornecendo mais dados para a rede neural. Esse índice de 70 a 75 por cento seria mais bem explicado na sessão de perguntas e respostas como sendo o “ajuste inicial do sistema”, cuja precisão final atingiria 98 por cento que é o exigido pela ABNT para o sistema.

Augusto explicou que no sistema baseado em voz o locutor fica instalado numa cabine com ruído controlado, ouvindo e repetindo o que está sedo dito para depois ser digitado. Apresentou, ainda, o funcionamento do que ele chamou de módulos que visam auxiliar a locução:

• módulo de locução: constituído por um motor de reconhecimento de fala e de teclas especiais de atalho para executar comandos como identificação do falante, nota musical ou clear, por exemplo;

• módulo de validação: recebe todo o texto gerado na estação de locução e valida toda a informação;

• módulo de texto pronto: importa arquivos de texto em formato .txt, exibe em modo rollup e pop-on e prevê o uso de, por exemplo, posicionamento, nota musical, etc.

• módulo de teleprompter: recebe os dados do teleprompter, filtra esses dados e exibe.

Para esse tipo de trabalho é exigido do operador bastante treinamento e capacitação. O treinamento é geralmente rápido (cerca de uma semana) e com um mês de trabalho o operador estará produzindo com eficiência.

Como um panorama geral, Augusto disse que o aperfeiçoamento dos sistemas de reconhecimento dos sistemas de voz trouxe uma nova perspectiva para o mercado americano e que o Brasil está seguindo a mesma tendência.

Terminadas as explanações, foi aberta a sessão de “perguntas e respostas”. Algumas questões foram levantadas a respeito da aplicação do exigido pela Legislação da Acessibilidade, em vista de dificuldades encontradas nos sistemas de televisão já em operação e também com relação ao tempo de inserção dos recursos versus tempo de programação das emissoras. Depois de respondidas pelos palestrantes, dois funcionários do Ministério das Comunicações pediram a palavra e explicaram que as normas podem ser aprimoradas e pediram que as dúvidas e dificuldades sejam informadas ao Ministério para que possam ser estudadas possíveis adaptações e alterações.

Alberto é Supervisor de Projetos da TV Cultura de São Paulo, diretor da Adeseda – Consultoria e Projetos e Coordenador e Revisor Técnico da Revista da SET. E-mail: [email protected]

|

|

O que está programado para o ano de 2016 no Brasil já aconteceu em praticamente 100 por cento do território japonês. No dia 24 de julho de 2011 foi finalizado o chamado switch off, com pequenas exceções de áreas atingidas pelo terremoto e pelo tsunami – que o acompanhou – e que estão ainda sendo atendidas pelo sistemas analógico em caráter provisório.

Segundo a palestra desenvolvida por Fumihiko Numata, representante do Ministério das Comunicações do Japão, as transmissões oficiais de TV digital em seu país tiveram início em dezembro de 2003 e durante, aproximadamente, oito anos, as transmissões analógicas e digitais conviveram juntas até 24 de julho de 2011, quando foram encerradas as transmissões analógicas.

Países como Bélgica, Holanda, Finlândia, Suécia, Suíça, Alemanha, Estados Unidos da América, Dinamarca, Noruega e Espanha também já desativaram suas transmissões analógicas. Ainda este ano, estão progamadas as desativações no Canadá e França. O Reino Unido já tem uma parte desativada e pretende concluir os trabalhos até o final de 2012, assim como, a Coréia e outros países.

Veja com foi o cronograma elaborado pelos japoneses para realizar o switch off. Em outubro de 1998 foi quando o governo japonês anunciou o plano para a digitalização das transmissões de TV digital aberta através do “Terrestrial Digital Broadcasting Council”. Em julho de 2001, depois de uma revisão do “Radio Act” formulada em junho deste mesmo ano, foi decidido que as transmissões analógicas seriam desativadas em 24 de julho de 2011.

Em 01 de dezembro de 2003 tiveram início as transmissões de TV digital terrestre nas três maiores áreas metropolitanas do território japonês. Em 01 de abril de 2006 entrou em operação normal o serviço de um segmento, ou seja, sinal de TV digital nos celulares, nos veículos automotores, trens, etc? No dia primeiro de dezembro de 2006, todo o território japonês já era suprido com sinais de TV digital. Como já foi mencionado em 24 de julho de 2011 as transmissões de TV analógicas tiveram seus sinais desligados com exceção de algumas áreas afetadas pelo terremoto e tsunami de 11 de março de 2011.

O Japão foi o primeiro país a ter os sinais de TV analógicos desligados em larga escala e o fez com sucesso. Mais 120 milhões de pessoas podem assistir transmissões terrestres de TV aberta e o número de estações de TV, entre geradoras e retransmissoras, é mais de 10 mil. Numa comparação com os Estados Unidos podemos constatar que a densidade no Japão é cinco vezes maior. Senão vejamos: A população dos Estados Unidos é 308.750.000 habitantes e o número de estações de TV é de 2.218. No Japão, a população é de 128.056.026 habitantes e as de estações de TV somam mais de 10 mil. Até julho de 2011 o Japão tinha aproximadamente 15 mil estações de TV analógicas de VHF e UHF nos canais 1 a 61. Esse número baixou para aproximadamente 11 mil estações de TV digital a partir de 24 de julho de 2011.

Esclarecimentos à população

O Ministério das Comunicações elaborou um plano de divulgação e esclarecimentos à população sobre a transição (DTTB). Em todo território, foram montados centros de esclarecimentos, call centers, divulgação publicitária, avisos radiofônicos, seminários e publicação específicas para tirar dúvidas e auxiliar os cidadãos japoneses. Também foram criadas comissões especiais para os idosos e pessoas de baixa renda.

Com um veículo equipado, foram feitos testes de cobertura e medidas de recepção, para ter controle sobre a condição da cobertura, ou seja, onde teria boa cobertura e onde seriam necessárias providências a respeito.

Suportes temporários

Antes, durante e após a transição, no período de 15 de junho a 26 de agosto de 2011, foram disponibilizados pelo governo em diversos locais, agências para esclarecimentos de dúvidas e serviços, assim como os procedimentos e como executá-los.

Os contatos podiam ser feitos pessoalmente ou por telefone e seriam transferidos para o setor que melhor lhes esclarecessem a dúvida. Em paralelo foi feita publicidade por rádio e outros meios de comunicação, e por vezes visitas domiciliares caso os problemas persistisse.

Foi também colocado em disponibilidade um telefone direto que redirecionava o cidadão para a agência central caso em sua agência local não houvesse ninguém da equipe técnica para atendê-lo.

Metas da migração

A capital Tókio, as cidades de Osaka e Nagoya, assim como, suas respectivas áreas metropolitanas iniciaram as transmissões digitais em 2003. As demais regiões tiveram o início da digitalização da TV em 2006. Para esses eventos foram utilizadas, sempre que possível, infraestrutura já existente. Por exemplo torres, estações transmissoras, estações retransmissoras, links, etc.

Suporte e padrão para a digitalização

Em áreas remotas cuja recepção nas residências se tornou difícil devido a obstáculos naturais como montanhas ou colinas, foram instaladas antenas em locais altos (morros), feita a conversão do sinal de TV e distribuído o sinal para as residenciais através de cabos.

Em edifícios que usavam antenas para recepção de VHF, foi acrescentada uma antena de UHF no sistema de antena coletiva desde que os moradores entrassem em consenso.

Onde a recepção se tornava fraca devido à sombra ocasionada por prédio ou outro tipo de construção, instalou-se antenas sobre as referidas e com cabos de descida o sinal era distribuído. Em recepção normal a orientação foi acrescentar uma antena de UHF e demais equipamentos como: misturador, receptor digital caso a TV fosse analógico splitter (divisor) no caso de mais de um receptor, etc. Nos casos de TV a cabo, a própria empresa se encarregou de fazer as adaptações.

Nas áreas onde os sinais não tinham condições de recepção por nenhum meio terrestre, o Ministério das Comunicações e os radiodifusores estão transmitindo temporariamente até março de 2015 a programação normal por satélite.

Popularização dos receptores digitais

Com o objetivo de promover a popularização e distribuição dos receptores digitais mais simples foram desenvolvidos e produzidos produtos mais baratos. Um simples receptor conectado a um aparelho de TV analógico era o necessário para receber o sistema digital em SDTV (Standard Definition TeleVision). Em 2008 o valor de um receptor estava em torno de 19.800 yens. Agora os preços caíram 80 por cento e estão custando perto de 3.950 yens.

A NHK na transição A NHK na transição

O diretor Takayuki Ito, representante da NHK – emissora pública no Japão – nos relatou que em 24 de julho de 2001 através de uma emenda na lei radiofônica foi efetivada uma data – dez anos a partir daquele momento – para o término das transmissões analógicas da emissora.

Em 01 de dezembro de 2003, a NHK seguindo as diretrizes começou a transmitir os sinais digitais em três das maiores áreas metropolitanas do Japão juntamente com as outras emissoras. Em 01 de abril de 2006 tiveram início os serviços de one-segment (um segmento) para celulares, veículos, trens, receptores manuais e afins. Em 01 de dezembro de 2006 os sinais digitais foram expandidos para todo o território japonês. Em 24 de julho de 2011 foram desligados os sinais analógicos em toda a nação com exceção dos territórios de Miyagi, Fukushima e Iwate devido às complicações causadas pelo terremoto seguido do tsunami de março de 2011.

Durante a transição a largura de banda ocupada por todos os canais era de 370 MHz sendo que os canais 1 a 3 ocupavam a banda baixa de VHF (90 a 108 MHz), os canais 4 a 12 ocupavam a banda alta de VHF (170 a 222 MHz e os canais 13 a 62 de UHF ocupavam de 470 a 770 MHz num total de 300 MHz.

Finda a transição, a largura de banda foi diminuída para 240 MHz; a banda de VHF, canais 1 a 12 (90 a 108 e 170 a 222 MHz), foi alocada para novos serviços (Multimídia broadcasting, aplicações em controles de desastres naturais, etc.); a parte alta da banda de UHF, canais 53 a 62, também será usada em novos serviços, provavelmente em telefonia móvel, e em desenvolvimento para segurança de transportes rodoviários, além de outras aplicações. A faixa de transmissão ficou com 39 canais do canal 13 ao canal 52 com uma banda total de 240 MHz.

A expansão de serviço de TV digital no território japonês teve um crescimento significativo desde a sua implantação, em 2003 a área coberta atingia 3,25 por cento do território, em 2004 já cobria 10,40 por cento, em 2005 superava os 25 por cento, em dezembro de 2006 a cobertura era de 82,85 por cento e em julho de 2011, 98 por cento do Japão já recebia os sinais de TV digital.

Na totalidade de 52 milhões de residências, em torno de 51 milhões (98 por cento ) recebem sinal de TV digital por cobertura direta ou indireta, 800 mil residências em áreas rurais recebem o sinal por recepção comunitária, ou seja, o sinal é recebido em local alto e distribuído por cabos; e o restante, em torno de 200 mil que perderam o sinal com o evento da TV digital, recebe agora a cobertura da programação normal através de satélite.

Através de levantamento realizado no Japão chegou à conclusão que 23 milhões de lares têm cobertura por sinais diretos, 17 milhões possuem cobertura por antenas coletivas ou recepção comunitária e 8 milhões de lares têm coberturas indiretas, pois sofrem sombras causadas por algum tipo de obstáculo no caminho do sinal (prédios, árvores, montanhas, etc.).

Enfim, o Japão fez seu desligamento analógico e a conclusão foi bem sucedida.

Switch-off no Brasil: a experiência japonesa.

A engenheira Patrícia Ávila, do Ministério das Comunicações do Brasil, esteve no Japão durante o switch-off japonês e comentou a experiência na qual participou, e a comparou com o que deve acontecer no Brasil em 2016.

A estratégia japonesa constou do desenvolvimento cooperativo entre governo, radiodifusores, fabricantes e instaladores, para que a implementação do projeto do switch-off da TV analógica japonesa fosse concretizada. Entre os itens analisados estavam:

Implementação de plano de ação para a implantação com metas e cronogramas definidos; Acompanhamento de como estava sendo a penetração e aceitação dos receptores nos lares;

Comunicação das ações realizadas e dos resultados alcançados em estatísticas;

De acordo com Patrícia, o objetivo é garantir que todas as regiões do país recebam a cobertura dos sinais digitais.

Analisando o sucesso japonês no switch off, e estudando as premissas expostas para o nosso caso que deve ser muito mais difícil devido a extensão de nossas fronteiras e o tamanho do nosso território a ser coberto, estamos torcendo para que também tenhamos sucesso quando chegar a nossa vez que está marcado para 2016 exatamente no ano das Olimpíadas no Brasil.

As Olimpíadas com certeza vão acontecer, será que o “switch-off” também?

Edson é supervisor técnico de Manutenção de RF da TV Cultura em São Paulo. Email: [email protected]

|

|

O termo “Cloud Computer” ou computação em nuvem já há algum tempo é a expressão do momento no mundo da tecnologia testificada assim pela Gartner Group, importante empresa de consultoria na área de Tecnologia da Informação (TI). Hoje a computação em nuvem alcança também o mercado de radiodifusão através de aplicações fascinantes e redução de custos consideráveis em algumas tarefas. Sem dúvidas é um atrativo sem precedente para este mercado. O termo “Cloud Computer” ou computação em nuvem já há algum tempo é a expressão do momento no mundo da tecnologia testificada assim pela Gartner Group, importante empresa de consultoria na área de Tecnologia da Informação (TI). Hoje a computação em nuvem alcança também o mercado de radiodifusão através de aplicações fascinantes e redução de custos consideráveis em algumas tarefas. Sem dúvidas é um atrativo sem precedente para este mercado.

Conceito

O conceito da computação em nuvem é a utilização de memória, capacidade de processamento, armazenamento de servidores compartilhados e integrados através da internet ou intranet. Tudo isso é possível através da evolução dos meios e das conexões, proporcionando assim aumento de velocidade e maior disponibilidade dos serviços “on-line”. Os dados armazenados na nuvem podem ser acessados de qualquer local, sem barreiras geográficas. Um exemplo que afeta nosso dia a dia é a conta de e-mail’s. Não precisamos mais armazená-los em nosso computador pessoal e rodar um aplicativo de gerenciamento para visualizá-los. Eles podem ser mantidos na nuvem, inclusive com gerenciamento do próprio provedor. Esta é a grande evolução, a possibilidade de rodar aplicativos na nuvem não necessitando nenhuma instalação no computador de acesso.

Modelo de implantação

Existem muitos tipos de nuvens que atendem diferentes necessidades, assim como qualquer tipo de aplicação um bom estudo inicial é essencial para alcançar o sucesso do projeto.

Nuvem Privada

A nuvem privada pertence a um único usuário que pode contratar um datacenter ou construir sua própria estrutura de software e hardware, tendo o controle sobre aplicações, gerenciamento de arquivos e processos, gerenciamento de automações e virtualização, ficando muito próximo de um datacenter tradicional.

Nuvem Pública

A nuvem pública é àquela caplicação, plataforma e infraestrutura são executadas e coordenadas por terceiros, assim como o gerenciamento do fluxo de dados.

Nuvem em Comunidade

É quando um grupo ou uma comunidade com interesses em comum compartilham uma infraestrutura de nuvem, podendo ser administrada por terceiros ou pelas organizações.

Nuvem Híbrida

É uma composição entre os modelos de nuvem pública e privada, compartilhando fluxos de dados, aplicações e armazenamento entre esses modelos.

Radiodifusão e a computação nas nuvens

Computação em nuvem é a convergência de aplicativos e infraestrutura visando melhor aproveitamento de utilização. Este modelo prevê melhor investimento em hardware, consolidando esses recursos, podendo ser aproveitados ao máximo com melhor gerenciamento, possibilitando melhor distribuição da capacidade computacional, proporcionando economia de investimentos.

Segundo Clifton Ashley, diretor da Google Enterprise para a América Latina, os departamentos de TI no modelo tradicional gastam 80 por cento do seu tempo com a manutenção de sistemas, no gerenciamento de dados e manutenção dos aplicativos em operação. Segundo ele é jogar dinheiro fora, o que é inaceitável nos dias de hoje.

A maioria das empresas não tem como atividade principal a gestão de TI, então é coerente contratar sob demanda a computação na nuvem como apoio nos processos de gestão.

Há várias aplicações e possibilidades para o mercado de radiodifusão e muitas especulações de produtos que podem agregar o workflow das emissoras. Grandes empresas de TI que desenvolvem produtos para este meio, estão trabalhando na concepção e melhoria de produtos, que vão desde o gerenciamento dos arquivos de baixa resolução até o produto finalizado. Um exemplo de workflow utilizado por algumas emissoras é a transcodificação de vídeo de alta definição para resolução compatível para internet. Um dos grandes provedores para esse tipo de serviço é a Amazon, que oferece a preços bem atraentes e qualidade excepcional.

Esta empresa de varejo para suportar a demanda das datas de pico de vendas investiu em poderosos parques de hardwares que, por sua vez, ficavam ociosos em outros períodos. Há quase 10 anos, a Amazon vem investindo na prestação de serviços, como o S3 “Simple Storage Solution”, que permite ao usuário comprar espaço de armazenamento, e o EC2 “Elastic Computer Cloud”, que possibilita usar máquinas virtuais e servidores de alto desempenho com aplicativos destinados para diferentes fins.

EC2 – “Elastic Computer Cloud”

É um serviço que proporciona capacidade de processamento dinâmico na nuvem. Se existir necessidade por maior processamento este pode ser contratado, automaticamente, sob demanda. Um modelo tradicional fora da nuvem, a infraestrutura deverá sempre contemplar o cenário mais crítico, pois a escalabilidade, nesse caso, gera custos e demanda muito tempo de implantação, desperdiçando energia e investimento desnecessários nos períodos de ociosidade.

Nas aplicações de radiodifusão o contrato de processamento sob demanda pode reduzir custos se executados na nuvem. Por exemplo, renderização de um programa, renderização de objeto 3D ou transcodificação de formato de vídeo.

S3 “Simple Storage Solution” S3 “Simple Storage Solution”

O S3 é o serviço de armazenamento para internet. Os provedores desse serviço garantem disponibilidade e segurança para os dados lá armazenados, trabalham com políticas de pastas e usuários como se o servidor estivesse na própria empresa. Também de forma escalonável, pode ser contratado espaço sob demanda. A proposta é ser um sistema confiável, rápido, econômico e simples. O fator mais crítico desse sistema é a segurança, considerando que os dados ficam on-line o tempo todo. Mesmo com a garantia dos provedores ainda levará um tempo para as emissoras começarem utilizar esse serviço integralmente.

Conclusão

A Computação em nuvem futuramente será sinônimo de computação, pois esse modelo é motivado pelo melhor aproveitamento dos recursos computacionais e consequentemente dos recursos naturais, pois é mais eficiente. É uma revolução que ainda não evoluiu até seu clímax, pois depende da qualidade e disponibilidade da conexão de internet.

Esse modelo não requer bom processamento nas pontas para acessar as aplicações, pois este está a cargo da nuvem. O usuário final precisa apenas de um terminal com boa conexão de internet, tornando-se mais acessível às classes desfavorecidas.

Computação na nuvem não tem somente ligação com desenvolvimento tecnológico, mas sim com negócios. A agilidade desse modelo proporciona valor comercial, reduzindo custos e gerando novas oportunidades. No modelo tradicional a infraestrutura e softwares são adquiridos antecipadamente mediante um projeto baseado em suposições, sem a certeza de retorno. Na computação em nuvem os projetos podem ser concebidos sob demanda, reduzindo o risco de aquisições desnecessárias.

Para o mercado de radiodifusão, creio que aumentarão as ofertas de produtos sob demanda, tais como, plug-ins que poderão funcionar em um arquivo na nuvem por “x” vezes ou por um determinado tempo, licenças de softwares online. Armazenamento temporário de grande volume de acervo, proporcionando, por exemplo, a substituição das LTOs (Linear Tape-Open) pelo armazenamento em nuvem, que hoje já tem o custo mais atraente.

A maior vantagem da computação em nuvem é a possibilidade de utilizar aplicativos sem que estes estejam instalados no computador, melhorando muito a administração e a manutenção dos terminais, tornando-os simples e seguros. Em breve o futuro repetirá o passado, quando os “terminais burros”, aposentados na final da década de 80, voltarão a ativa com nova roupagem, mas esses agora acessarão grandes datacenters com capacidade de processamento e armazenamento quase imensuráveis.

Gilvani é Coordenador de Engenharia EBC – SP. Email: [email protected]

|

|

O estande do Fórum do Sistema Brasileiro de TV Digital (SBTVD) mostrou, com exclusividade para os participantes do Congresso da Sociedade Brasileira de Engenharia de Televisão – SET 2011, o primeiro protótipo de portal interativo que a TV Brasil vai disponibilizar aos telespectadores brasileiros. O modelo está em fase de testes e será lançado, em breve, pela Empresa Brasil de Comunicação (EBC), primeiramente no Rio de Janeiro, São Paulo e Brasília, onde a TV Brasil tem transmissão digital, segundo informou Emerson Weirich, gerente-executivo de Engenharia da TV Brasil, em entrevista à Revista da SET, durante o evento.

O portal vai oferecer interatividade local com notícias em tempo real, informações sobre as áreas de maior lentidão no tráfego, previsão do tempo, sobre a política de comunicação da EBC e a filosofia que deram origem à empresa, além de interatividade plena, que permitirá ao telespectador, por exemplo, usar o canal de retorno para participar de enquetes, acessar serviços bancários, Previdência Social e outros órgãos, obtendo resposta sobre informações acerca dos benefícios, podendo, também, enviar vídeos à emissora.

Segundo Weirich, através desse portal interativo, a EBC pretende ampliar seus canais de comunicação e promover maior interlocução com a sociedade, utilizando a convergência midiática. O portal de interatividade da TV Brasil fará interface com outras plataformas que estão na esfera administrativa da EBC, como a TV NBR, TV Brasil Internacional, Agência Brasil de notícias e mais oito rádios, expandindo a participação social nas diversas mídias gerenciadas pela empresa. A seguir o gerente-executivo nos dá uma explicação mais detalhada de como foi a apresentação do conceito e novidade do portal, durante o evento.

Quais novidades o portal da TV Brasil trará aos telespectadores e em que se diferencia de outros canais? Quais novidades o portal da TV Brasil trará aos telespectadores e em que se diferencia de outros canais?

O protótipo é uma versão beta, mas que gera todos os conceitos da interatividade no padrão brasileiro Ginga. O portal conta com aplicativos com interatividade local, manda informações pela radiodifusão, pela transmissão, pelo espectro, que podem ser lidas, abertas e interagem localmente no aparelho. Disponibiliza, também, a interatividade plena, na qual, através de um canal de retorno, via telefone, internet, SMS, o usuário manda uma requisição, uma informação de volta para o radiodifusor. É um protótipo que explora os dois modelos. É um portal e é diferente do conceito que a maioria das empresas está trabalhando. É um aplicativo mestre de interatividade que carrega outros aplicativos dentro dele. Como somos um veículo de comunicação, temos alguns menus nesse protótipo que interagem com nossos veículos internos de comunicação. Por exemplo, o menu da Agência Brasil, que é um veículo de comunicação da EBC, que por sua vez já é um veículo convergente, multimídia e a gente trouxe esse conceito convergente para dentro do aplicativo. Pois a EBC tem rádio, TV, internet, várias plataformas. E como essa informação já esta pronta, nós simplesmente acessamos de uma forma automatizada o banco de dados. O banco de dados da EBC está pronto e fizemos uma ferramenta interna que busca as notícias e as coloca dentro do transmissor local.

Que tipo de interatividade foi possível realizar no estande do SBTVD, através desse protótipo da TV Brasil?

Durante o Congresso da SET, o transmissor da TV Brasil, em São Paulo, recebia através do ar – uma informação da nossa ferramenta. É uma interatividade local e automatizada. Por exemplo, durante o Congresso da SET, podemos ver quais são as últimas notícias publicadas no site da TV Brasil, de uma forma automática. Não tem uma equipe produzindo apenas para o serviço interativo. Podemos ver também os dois menus EBC e TV Brasil que estão no portal interativo e que são mais institucionais, com a filosofia da empresa. A TV Brasil tem um botão amarelo no qual se vê onde assistir a TV Brasil, ou seja, todas as cidades onde há canal digital e analógico.

Esse serviço já está disponibilizado nas capitais onde a EBC está transmitindo em sinal digital?

É o nosso próximo passo. Ainda é um protótipo e não entrou no ar em caráter definitivo. As experiências estão começando onde temos transmissão digital, que é Rio de janeiro, São Paulo e Brasília e logo estaremos expandido para Belo Horizonte e Porto Alegre, que são as cidades para onde está crescendo a transmissão digital da TV Brasil.

Há possibilidade de antes de 2016 as cidades com sinal analógico transmitirem em sinal digital?

O ano de 2016 eu diria que é meta obrigatória. Nós teremos que transmitir digital nessas capitais. Mas depende de investimentos. Quando houver disponibilidade desses investimentos nós faremos essas implantações.

A prioridade, por enquanto, é expandir a TV Brasil em todo território brasileiro, mesmo que analógica, e um segundo passo seria a digitalização?

Na verdade não. Por exemplo, em Belo Horizonte e Porto Alegre já estamos entrando diretamente em digital. Somente em digital. Estamos vendo que os brasileiros estão adquirindo aparelhos de TV com set-top boxes embutidos (conversores) e os brasileiros já estão se preparando para receber o sinal digital e por isso estamos dando prioridade para transmissões digitais nas grandes cidades.

Quem desenvolveu esse sistema interativo?

Esse protótipo foi criado pela EBC, no departamento de engenharia.

Quando os brasileiros terão essa interatividade no ar? Quando os brasileiros terão essa interatividade no ar?

Muito em breve. Estamos fazendo uma série de testes antes de colocar a aplicação no ar. Temos um laboratório de testes, uma pequena estação de TV, de radiodifusão, onde nós colocamos várias tevês, vários receptores com diferentes implementações de middleware Ginga e fazemos o teste de implementação. Hoje, nem todas as versões de middleware estão 100 por cento implementadas nos aparelhos vendidos nas lojas e algumas versões que entraram no mercado são antigas e nosso aplicativo tem que funcionar em todos os aparelhos de TV. Uma plataforma aberta e uniformizada. Então fazemos essa bateria de testes antes de colocar o aplicativo no ar porque a intenção é que o usuário de TV digital tenha boa experiência. Essa é a preocupação da EBC, do Fórum SBTVD e da SET. Todos estão comprometidos para que o usuário da TV digital tenha boa experiência.

Mas vejo que esse protótipo não oferece muitos serviços aos cidadãos.

Na verdade, o portal tem duas partes. Uma parte é da EBC. A comunicação que a EBC já realiza, estamos trazendo para esse portal. A outra parte é de serviços ao cidadão. Alguns chamam de T-Gov. Temos várias parcerias. Vamos disponibilizar os voos da Infraero, informações sobre trânsito, Previdência Social, Caixa, Banco do Brasil. São parcerias que estabelecemos porque temos trabalhado junto a outros órgãos de governo que têm se motivado a desenvolver soluções no padrão Ginga. Então vamos trazer para o portal serviços que eles têm hoje em outras plataformas, utilizando essa tecnologia. É como se fosse um sub-menu, onde carregamos outros aplicativos, dentro do nosso aplicativo. Por isso esse conceito de portal. Um exemplo é uma versão de laboratório, em funcionamento, que oferece informações sobre voos da Infraero e órgão do Governo Federal. Tem aplicativos para outras plataformas como Android, internet, Iphone e tem uma plataforma que está sendo desenvolvida para interatividade. No que se refere à previsão de tempo, temos informações do Instituto Nacional de Meteorologia (Inmet), do Ministério da Agricultura. São informações públicas. Todas as informações fazem interface com os serviços oferecidos ao cidadão pelos órgãos governamentais. No que se refere ao trânsito, tem uma inovação que trazemos nesse protótipo de interatividade. Em cada cidade existe um órgão público que toma conta do trânsito e mantém uma comunicação com os veículos de mídia, informando os gargalos do trânsito e pontos de maior congestionamento. Nós conversamos com a Companhia de Engenharia de Tráfego (CET) de São Paulo e trouxemos para o portal informações, em tempo real, dentro do conceito de radiodifusão que é TV aberta gratuita. São informações que o cidadão recebe, gratuitamente, tendo o receptor (set-top box) com Ginga embarcado. Não precisa ter acesso à Telecom, pago, para ter essa informação. Temos mais aplicativos públicos. Esse aplicativo da Previdência.

É o aplicativo TV digital Social desenvolvido pela Dataprev?

Eles fizeram parceria conosco porque esse órgão tem como fazer um desenvolvimento e uma simulação teórica no computador. Mas fazer uma transmissão broadcast envolve outros requisitos e daí é necessário um laboratório como o da EBC de radiodifusão que simula uma transmissão e daí o aplicativo precisa ser adaptado. O aplicativo foi desenvolvido em parceria conosco e está adequado para ser não somente um protótipo, mas um aplicativo que funciona na TV. Eles trouxeram o aplicativo e adequamos às normas da TV digital. Um aplicativo para TV não é como um aplicativo de computador, de internet, em que o ambiente é o computador. No aplicativo de interatividade o ambiente não é o computador. Você não pode simplesmente usar as ferramentas de desenvolvimento para simular. Você tem que fazer realmente todo o circuito, colocando no carrossel de dados, testando a recepção com receptores que estão no mercado, porque o telespectador vai usar set-top box de mercado, TVs de mercado. Então nosso laboratório tem diálogo, um intercâmbio com todos os fabricantes. Por isso, quando temos dúvidas sobre os receptores os consultamos.

Há certa resistência entre fabricantes de set-top boxes no sentido de padronizar os equipamentos para atender à norma Ginga?

Acredito que não há resistência. Sempre temos canal aberto com todos os fabricantes e todos estão abertos para fazer o Ginga funcionar.

Independentemente da marca e modelo de set-top box?

A implementação do middleware, o software Ginga que é carregado nos receptores, cada um faz a sua implementação. Uniformizar o comportamento desta implementação é atender todos os requisitos da norma e isso requer bateria de testes e simulações que nem sempre é possível, pois muitos fabricantes querem lançar logo o produto no mercado. Têm versões 1.0, 1.1, 1.2 dos produtos. Qualquer produto e sistema operacional têm várias versões, o up-grade. Isso é normal. Nada disso é motivo para inviabilizar o sistema. Os aplicativos estão aqui, estão funcionando, não são mais protótipos, são reais, estão funcionando em receptores comerciais. Os produtos o estande do Fórum SBTVD já são produtos de mercado e comercializados em larga escala e os aplicativos funcionam. O que acontece é que às vezes alguma função em nível de programação, linha de comando de programação, código de programação de alguns televisores não está funcionando ou tem um comportamento diferente. Por exemplo, o menu não cai na posição que a gente queria. Mas é só adaptar o código de programação que ele vai se comportar.

Qual a possibilidade de expansão dos serviços básicos do portal da TV Brasil? Haverá espaço para patrocínio cultural?

Essa é uma discussão que está acontecendo na EBC. Estamos no primeiro estágio, que é o que estamos trazendo ao congresso da SET e mostrando no estande do Fórum SBTVD. Na verdade trata-se de um estágio técnico, que explora todas as funções tecnológicas da plataforma. Nós exploramos a parte dos veículos de comunicação da EBC, aplicativos com serviços públicos, a parte de interatividade local, interatividade plena, com canal de retorno. É um aplicativo completo que explora todas as possibilidades. Agora, vamos discutir quais as novidades que podemos implementar na plataforma. O menu “aplicativos” que já consta no portal é justamente para ser um laboratório de ferramentas de comunicação pública, que é um dos grandes objetivos do Ginga. Então há grande espaço para expansão.

Madrilena é jornalista/TV UFPB. Mestre em TV Digital/ Unesp-SP. Email: [email protected]

|

|

Quando a legislação sobre a acessibilidade, instituída pela Portaria 310 do Ministério das Comunicações, foi assinada em 2006, já havia passado quase seis anos desde o início da vigência da Lei 10.098, que estabeleceu as normas e critérios básicos para a promoção da acessibilidade.

A portaria aprova a Norma 001/2006 sobre os recursos de acessibilidade para a TV aberta, mas seus itens ainda causam diferentes interpretações e, mesmo depois da alteração dada pela Portaria 188 ainda há divergências e discussões.

Os quatro recursos tratados são a legenda oculta, a audiodescrição, a janela de LIBRAS e a dublagem. De acordo com a norma da ABNT NBR 15290, os recursos podem ser definidos como:

• Dublagem: Tradução de programa originalmente falado em língua estrangeira, com a substituição da locução original por falas em português, sincronizadas (no tempo, entonação, movimento dos lábios das personagens em cena etc.).

• LIBRAS: Língua de natureza visualespacial, com estrutura gramatical própria, que constitui o sistema linguístico de comunidades surdas do Brasil.

• CC (closed caption): Legenda oculta em texto que aparece opcionalmente na tela do televisor, a partir do acionamento do dispositivo decodificador, interno ou periférico. Disponível somente em televisores que possuam decodificador. Concebida originalmente para surdos.

• Descrição em áudio de imagens e sons (audiodescrição): Narração descritiva em voz de sons e elementos visuais-chave – movimentos, vestuário, gestos, expressões faciais, mudanças de cena, textos e imagens que apareçam na tela, sons ou ruídos não literais – despercebidos ou incompreensíveis sem o uso da visão.

Apesar de já amplamente divulgada e utilizada, a dublagem entra nessa norma, especialmente, para incluir a audiodescrição em seu canal. Assim, o cronograma de dublagem + audiodescrição (sendo a dublagem já cumprida pela totalidade das emissoras) passa a ser limitado pelo cronograma de audiodescrição. Isto é, quando necessário a audiodescrição deve ser mixada juntamente ao som dublado do programa e não ao original.

A obrigatoriedade da janela de LIBRAS é restrita aos programas institucionais e político- partidários, sendo o encargo da produção e superposição da janela do órgão governamental ou partido político responsável pela peça publicitária. Aos participantes do fórum de TV digital, que ajudam no projeto de desenvolvimento e implementação da TV digital no Brasil, cabe a incumbência de pesquisar uma solução técnica para o acionamento opcional da janela.

A legenda oculta e, agora, a audiodescrição são os recursos mais visados no momento. O primeiro pela ampliação do horário obrigatório, que fez com que muitas geradoras locais tenham que introduzir o closed caption em sua linha de produção para abarcar os programas regionais, e o segundo pelo início do seu cronograma nas geradoras digitais licenciadas.

Os posicionamentos aqui destacados são dados pela Associação Brasileira de Emissoras de Rádio e Televisão – Abert – e foram baseados em três princípios: a prudência, o caráter social da radiodifusão e a viabilidade técnica e econômica. Utilizandose desse posicionamento, a leitura das portarias e da norma pode ser resumida em alguns aspectos principais: Os posicionamentos aqui destacados são dados pela Associação Brasileira de Emissoras de Rádio e Televisão – Abert – e foram baseados em três princípios: a prudência, o caráter social da radiodifusão e a viabilidade técnica e econômica. Utilizandose desse posicionamento, a leitura das portarias e da norma pode ser resumida em alguns aspectos principais:

– A transmissão do recurso da Legenda Oculta (Closed Caption) é obrigatória a todas as estações seguindo o mesmo cronograma.

– A transmissão do recurso da audiodescrição é restrita às estações digitais. O cronograma é diferenciado para cada emissora, a partir da data de licenciamento da estação. Apesar de o licenciamento ser base para a contagem do prazo, a Abert aconselha às suas associadas que o prazo seja contado a partir da autorização de uso de radiofrequência, dado pela Anatel, para evitar diferentes interpretações.

A estenotipia e o reconhecimento de voz são as duas técnicas mais conhecidas para a produção da legenda oculta. A primeira baseia-se em um sistema em que um operador escuta o programa (ao vivo ou pré-gravado) e digita em um teclado especial – chamado estenótipo – as palavras ou mesmo frases com uma quantidade muito inferior de cliques, permitindo que a velocidade de escrita acompanhe a dinâmica da fala em programas ao vivo. Já a segunda técnica, atualmente, baseia-se em outro sistema em que o operador escuta o programa (ao vivo ou pré-gravado) e repete as mesmas falas para o aparelho de captura de voz. Graças ao pré-treinamento do sistema, ele é capaz de reconhecer a voz do operador e transformá-la em texto.